주변 센서 정보를 이용한 자동차 엔진 이상 탐지

© The Korean Society for Noise and Vibration Engineering

Abstract

This study proposes a new method of determining whether the state of a vehicle engine is normal or abnormal using measured data from various sensors around the engine and verifies its performance. To understand the obtained sensor data, a correlation between data from each sensor is developed, and an analysis is performed to classify data that can be used as a feature. The given sensor data are converted into gray images and color images to be used as training and test data. The performance in discriminating between normal and abnormal states of an automobile engine is evaluated using an autoencoder, convolutional neural networks, and transfer learning. It is confirmed that the proposed method can accurately classify the normal and abnormal states of the vehicle engine.

Keywords:

Anomaly Detection, Vehicle Engine, Transfer Learning, Convolutional Neural Network, Autoencoder, Deep Learning키워드:

이상 탐지, 자동차 엔진, 전이 학습, 합성곱 신경망, 오토인코더, 심층 학습1. 서 론

최근 독일의 4차 산업혁명을 시작으로 여러 국가에서 관심이 높아지고 있는 스마트 공장과 관련해 발전하고 있는 IoT 기술 등 끊임없이 생성되는 방대한 양의 데이터를 활용한 다양한 도전에 직면하고 있다. 이에 따라 빅데이터를 이용하는 방법에 대한 요구가 증가하고 있으며, 산업 빅데이터에 기반한 상태 진단 및 고장 탐지에 대한 연구도 많이 진행되고 있다(1~4). 최근에는 자동차와 관련하여 엔진 결함 진단 기술도 많은 발전을 하고 있다. 엔진은 차량의 동력원이자 핵심 부품으로 차량의 안전성과 신뢰성에 직접적인 영향을 주고 있으므로, 신속하고 정확한 모니터링 및 결함 진단을 위한 기술의 개발이 중요하다. 엔진 결함 진단 기술에서 이상을 탐지하는 방법에는 진동, 소리, 압력 및 온도와 같은 다양한 센서 정보를 조합하여 엔진 결함을 감지하고 식별하는 확률적 방법과 얻어진 데이터들에 기계학습을 적용하는 방법 등이 있다(5). 기계학습을 이용한 결함 진단 기술에서는 서포트 벡터 머신, 인공 신경망, 랜덤 포레스트 등을 사용하고 있다(6~8). 하지만 이러한 기술을 사용하는 시계열 데이터의 특징 추출은 단일 신호 내에서뿐만 아니라 다른 신호 내에서도 정보 손실을 유도한다. 이에 따라 최근 합성곱 신경망과 같은 딥러닝 모델이 결함 탐지 관련 분야에서 더 많은 관심을 받고 있다. 합성곱 신경망은 특징을 학습하는 능력이 있고 연속적인 데이터와 관련된 문제를 포함하여 다양한 분야에서 강력한 수단이다(9). 합성곱 신경망을 이용하여 자동차 엔진 이상을 탐지하는 연구로 Wolf 등(10)은 DNN 모델을 기반으로 ECU(Electrical Control Unit) 수치 데이터를 이용하여 PIs(pre-ignitions)을 감지하였다. Wang 등(11)은 디젤 엔진 공기 시스템의 결함을 감지하기 위해 오토인코더와 합성곱 신경망을 사용하였다. Kuzhagaliyeva 등(12)은 PCA와 결합한 합성곱 신경망을 사용하여 엔진의 사전 점화를 감지하였다. 하지만 LSTM과 오토인코더를 합성곱 신경망과 결합하여 분류 모델을 만들기 때문에 모델 복잡성이 높아지는 단점이 있다.

이 연구에서는 효과적으로 합성곱 신경망을 활용하기 위해 입력 이미지 변환을 적용하고 자동차 엔진의 상태가 정상인지 이상이 있는지를 판단하는 방법을 제안하고 성능을 검증한다. 제안된 방법의 평가를 위한 센서 데이터는 미국 Ford사에서 제공한 오픈 데이터 세트를 활용한다(13,14). 주어진 센서 데이터에 대한 이해를 위하여 각 센서 데이터 사이의 상관 관계를 분석하고, 특징으로 사용할 수 있는 데이터를 구분하기 위한 분석을 수행한다. 주어진 센서 데이터를 입력 데이터로 이용하기 위하여 회색 이미지와 컬러 이미지로 변환한다. 오토인코더와 직접 모델을 구성한 합성곱 신경망, 그리고 전이 학습을 이용하여 엔진의 정상과 비정상 상태를 구분하는 성능을 평가한다. 제안된 방법을 통해서 자동차 엔진의 정상과 비정상을 효과적으로 구분할 수 있음을 확인한다.

2. 데이터 분석

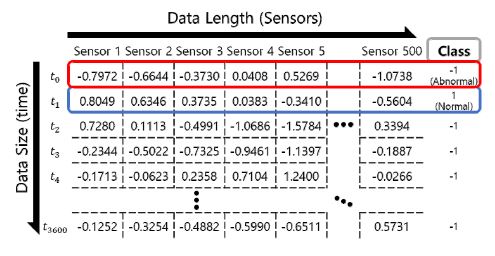

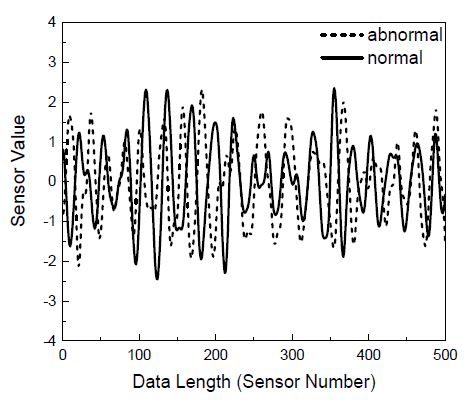

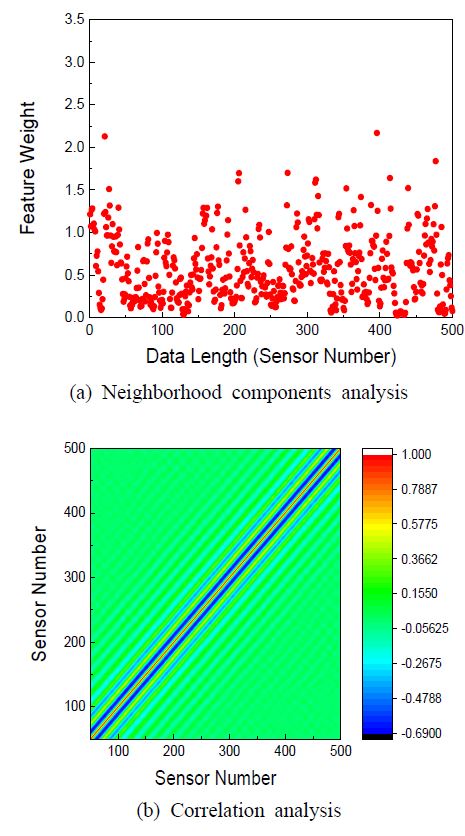

이 연구에 사용된 데이터 세트는 3601개의 훈련 데이터와 1320개의 테스트 데이터로 구성되어있다. 훈련 데이터의 구조를 Fig. 1에 나타내었다. 500개의 센서에 대하여 시간에 따른 센서 값들을 열벡터로 나타내었다. Fig. 1에 나타낸 바와 같이 열방향 벡터인 각 센서의 시계열 데이터에 대하여 정상 또는 비정상이 라벨링 되어 있지 않고, 행방향 벡터인 각 시각에서 500개의 센서 값에 대하여 정상 또는 비정상으로 라벨링 되어있다. 행방향을 데이터 길이(data length), 열방향을 데이터 크기(data size)로 정의하였다. 정상 데이터와 비정상 데이터에 대한 가시화를 수행하고 결과를 Fig. 2에 나타내었다. 특정 시각에서 500개의 센서 데이터 값들을 그래프로 나타내었고, 정상과 비정상 경우를 하나씩 나타내었다. 데이터 가시화는 데이터의 형태를 가장 직관적으로 확인할 수 있는 방법이자 이상치를 탐지하기 위해 사용된다. Fig. 2에서 나타난 바와 같이 가시화를 통해 특별한 이상치가 나타나지 않았고, 데이터의 정상과 비정상을 분류하기 위한 방법으로 사용하기는 어렵다는 것을 확인할 수 있다. 주어진 데이터의 특성을 이해하고 효율적인 분류를 수행하기 위해 데이터에 대한 간단한 분석을 수행하였다. 특징 선택 알고리즘의 하나인 근접 요소 분석(neighborhood components analysis, NCA) 알고리즘을 적용하여 데이터를 분석하였다. NCA 분석은 k-근접이웃(k-nearest neighbour, k-NN) 알고리즘을 기반으로 학습시 결정되는 특징의 가중치를 이용해 높은 가중치를 가진 특징을 선택을 하는 방법이다. Fig. 3 (a)에 나타난 것과 같이 500개의 센서들에 대하여 특징들의 가중치가 뚜렷하게 구분이 어려운 것을 확인하였다. 추가적으로 각 특징들 간의 상관성을 확인하기 위하여 상관 관계 분석을 수행하고 결과를 Fig. 3 (b)에 나타내었다. 결과에서 나타난 바와 같이 서로 다른 데이터 사이에 상관 관계가 매우 낮게 나타나는 것을 확인할 수 있다.

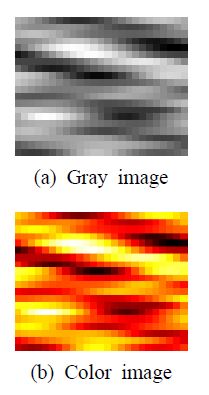

이 연구에서는 합성곱 신경망을 이용하기 위하여 측정 데이터를 이미지로 변환하여 사용하였고, 변환된 회색조 이미지와 컬러 이미지를 Fig. 4 (a)와 (b)에 각각 나타내었다. Fig. 4 (a)의 회색조 이미지는 데이터 세트의 최소값과 최대값을 고려하여 -6에서 6 사이의 값을 0에서 1까지의 값으로 정규화를 수행하여 변환하였고, 1 × 500 크기를 갖는 벡터 형태의 데이터를 20 × 25 × 1 행렬로 재구성하여 회색조 이미지로 변환하였다. Fig. 4 (b)의 컬러 이미지의 경우, 데이터 세트의 최소값과 최대값을 0부터 255까지의 값으로 정규화를 수행한 후에 MATLAB에서 색을 정의하는 값으로 구성된 행렬 중 하나인 hot 컬러맵에 대응시켜 변환하였다. 컬러 이미지 변환에서는 RGB 값을 갖는 20 × 25 × 3 행렬 형태의 이미지를 얻게 된다.

3. 분 류

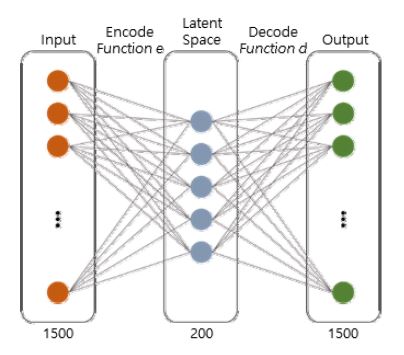

이 연구에서는 정상과 비정상 상태를 분류하기 위하여 오코인코더를 적용하였다. 오토인코더는 학습을 통해 입력 이미지와 동일한 이미지를 복원하여 출력할 수 있는 알고리즘이다. 정상 상태의 이미지를 이용하여 학습을 수행한 후, 정상 상태 이미지를 입력하면 잘 복원된 이미지를 출력할 수 있으므로 입력 이미지와 출력 이미지 사이의 차이는 매우 작다. 그러나 정상 상태 이미지로 학습을 수행한 후, 비정상 상태 이미지를 입력하면 이미지를 잘 복원할 수 없으므로 입력 이미지와 출력 이미지 사이의 차이는 크게 될 것이다. 이러한 특성을 이용하여 오토인코더를 이용하여 정상과 비정상을 분류할 수 있다. 본 연구에서 사용된 오토인코더의 구조는 Fig. 5 와 같다. 입력 계층의 크기는 입력 이미지의 크기와 동일하다. 은닉 계층의 뉴런 개수는 학습을 통해 뉴런 개수에 따른 성능을 비교하여 결정하였다. 결정 기준은 정상과 비정상 이미지를 훈련 데이터로 오토인코더를 거쳐 생성된 결과 이미지의 평균 제곱 오차 격차가 가장 클 때인 200개로 결정하였다. 오토인코더 모델은 학습용 데이터를 이용하여 학습하였고 사용된 하이퍼 파라미터들은 Table 1과 같다. 사용된 encode function e와 decode function d는 식 (1), (2)에 나타낸 바와 같이 각각 양의 포화 선형 전달 함수와 선형 전달 함수를 이용하였다.

| (1) |

| (2) |

다음으로 사용된 손실함수에 관한 수식은 식 (3)과 같다.

| (3) |

| (4) |

| (5) |

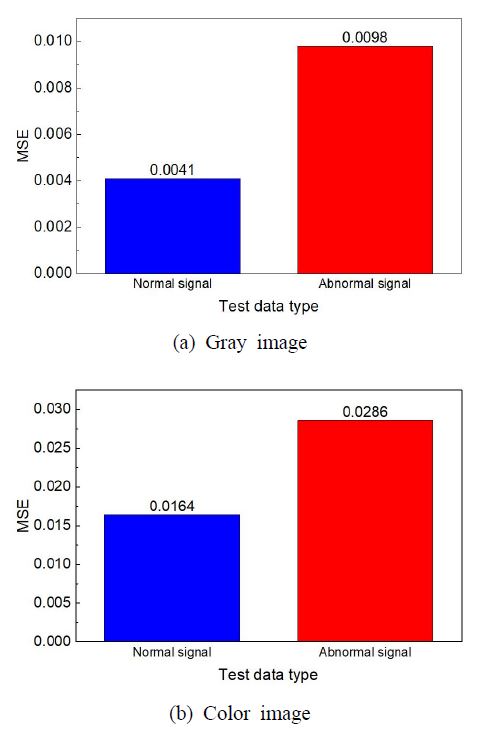

손실 함수 E는 평균 제곱 오차 항과 L2 가중치 정규화 그리고 희소성 정규화 항의 합으로 이루어져있다. L2 가중치 정규화와 희소성 정규화 항은 각각 수식 (4)와 (5)에서 확인할 수 있으며 학습시 과적합을 막기 위해 가중치를 줄이거나 소음 신호들을 제거하기 위해 사용된 것이다. 두 항은 각각의 계수 λ와 β로 학습 시 비율을 정할 수 있다. 이 연구에서 사용한 계수는 Table 1에 나타낸 바와 같이 0.01과 4이다. 학습된 오토인코더를 통해 생성된 이미지와 원본 이미지의 평균 제곱 오차를 Fig. 6에 나타내었다. 회색조 이미지를 이용한 결과인 Fig. 6 (a)에서 평균 제곱 오차가 정상 이미지와 비정상 이미지에서 2배 이상 차이나는 것을 확인하였다. 컬러 이미지를 이용한 경우 Fig. 6 (b)에서 나타난 바와 같이 평균 제곱 오차 값의 차이는 회색조 이미지를 이용한 경우의 오차보다는 작지만 비정상 이미지의 평균 제곱 오차가 더 큰 것을 확인할 수 있었다. 이러한 결과로부터 오토인코더를 이용하여 정상 상태와 비정상 상태의 분류가 가능한 것을 확인하였다.

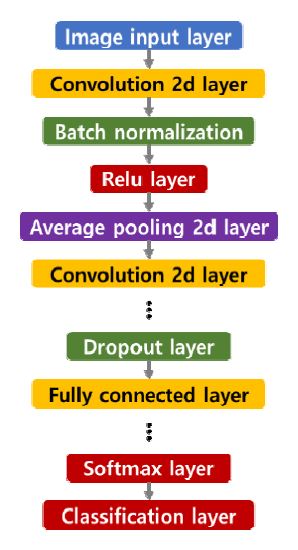

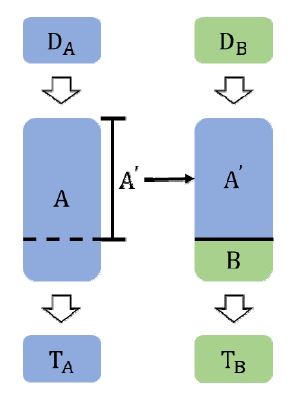

다음으로 합성곱 신경망을 이용한 분류를 수행하였다. 직접 제안한 구조의 합성곱 신경망 모델을 통해 분류 정확도를 확인하고 전이학습 모델을 이용하여 분류 결과를 검증하였다. 직접 제안한 합성곱 신경망 모델의 구조를 Fig. 7에 나타내었다. 총 3개의 2D 합성곱 계층과 3개의 완전 연결 계층으로 구성하였다. 사용된 훈련 알고리즘은 최적화 함수 SGDM(stochastic gradient descent with momentum)이다. 전이학습은 새로운 이미지를 분류할 때 훈련망을 처음부터 훈련하는 것보다 잘 훈련되어 있는 훈련망의 지식을 이용하여 학습시간을 단축하고 높은 분류 정확도를 얻을 수 있는 방법이다. Fig. 8과 같이 사전 훈련된 모델 A를 새로운 데이터 DB를 분류하기 위하여 사전 학습된 레이어인 A의 일부 레이어 B만 미세조정을 통해 학습하여 새로운 데이터와 관련성을 증가시켜 사용하는 것이다. 이 연구에서는 사전 훈련된 네트워크와 함께 적용하였으며, 사용된 네트워크는 Table 2에서 나타낸 것과 같이 AlexNet, SqueezeNet, ShuffleNet, GoogLeNet, ResNet-18을 사용하였다. 이 모델들은 주로 객체 분류에 사용된 잘 알려진 네트워크이다. AlexNet은 망의 깊이가 고성능을 위해 필수적이라는 논문의 결과로 만들어진 모델이며 가장 큰 파라미터 수를 가지고 있다. SqueezeNet, GoogLeNet 그리고 ResNet은 AlexNet과 달리 성능 향상을 위해 망의 깊이를 늘리며 발생하는 문제들을 해결하기 위하여 더 적은 파라미터로 높은 성능을 가진 모델이다. 그 중 GoogLeNet의 경우 각 층의 넓이를 늘려 하드웨어 자원을 최대한 효율적으로 이용하고 학습 능력을 극대화시킨 모델이다. ShuffleNet은 기존의 group convolution의 문제점을 shuffle을 통해 group간의 정보를 공유하게 함으로써 해결한 모델이다.

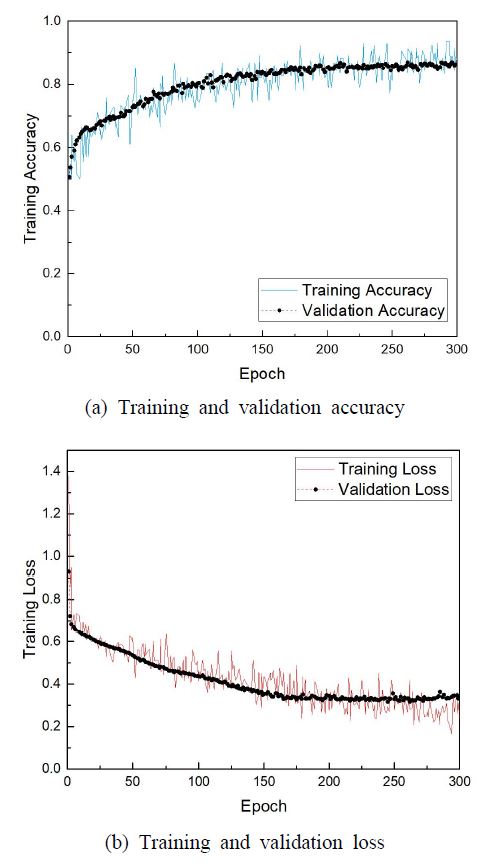

제안된 합성곱 신경망 모델의 학습 과정에서의 분류 정확도는 Fig. 9 (a)에 나타낸 것과 같이 90 % 정도로 높게 수렴하는 것을 확인할 수 있으며 검증 정확도를 함께 나타내었다. 학습 과정에서 학습 손실 및 검증 손실이 낮게 수렴하는 것을 Fig. 9 (b)에서 확인할 수 있다. 제안된 합성곱 신경망과 전이학습을 통한 분류 정확도를 Table 3에서 나타내었다. 전이 학습을 적용한 경우, ResNet-18 모델에서 제일 높은 분류 정확도인 96.36 %를 가지는 것을 확인하였고, 직접 제안한 합성곱 신경망 모델을 이용한 경우 94.55 %의 높은 분류율을 나타내는 것을 확인하였다. 전이학습에 사용된 사전 훈련된 신경망의 입력 이미지의 차원이 3차원이어서 컬러 이미지를 이용한 분류는 가능하였으나, 1차원인 회색조 이미지를 이용한 분류는 수행하지 못하였다. 본 연구에서 직접 제안한 CNN 모델에 회색조 이미지를 이용하여 분류를 수행한 경우 85.91 %의 분류 정확도를 갖는 것을 확인하였다. 컬러 이미지를 이용한 경우보다 약 8 % 정도 낮게 나타나는 것을 확인하였으며, 회색조 이미지는 1차원, 컬러 이미지는 3차원으로 회색조 이미지의 데이터 파라미터 수가 더 적어 학습 정보량의 차이가 생겨 발생한 것으로 판단된다.

4. 결 론

이 연구에서는 자동차 엔진 주변의 500개의 센서에서 측정된 정보를 이용하여 자동차 엔진의 상태가 정상인지 이상이 있는지를 판단하는 방법을 제안하고 성능을 평가하였다. 획득한 센서 데이터의 이해를 위해 센서 데이터의 특성을 분석하였다. 주어진 센서 데이터는 시계열 데이터이지만, 센서에 따라 정상과 이상이 구분되어 있지 않고, 동일 시간대에 전체 500개의 센서 신호에 대하여 정상과 이상이 구분되어 있는 특징이 있다. 주어진 센서 데이터를 회색 이미지와 컬러 이미지로 변환하여 입력 데이터로 이용하였다. 오토인코더와 직접 모델을 구성한 합성곱 신경망, 그리고 전이 학습을 이용하여 엔진의 정상과 비정상 상태를 구분하는 성능을 평가를 수행하였고, 제안된 방법을 통해서 자동차 엔진의 정상과 비정상을 효과적으로 구분할 수 있는 것을 확인하였다.

Acknowledgments

이 연구는 금오공과대학교 학술연구비로 지원되었음(202001190001).

References

-

Xu, X. and Hua, Q., 2017, Industrial Big Data Analysis in Smart Factory: Current Status and Research Strategies, IEEE Access. Vol. 5, pp. 17543~17551.

[https://doi.org/10.1109/ACCESS.2017.2741105]

-

Rehman, S., Hark, A. and Gruhn, V., 2017, A Framework to Handle Big Data for Cyber-physical Systems, 8th IEEE Annual Information Technology, Electronics and Mobile Communication Conference (IEMCON). pp. 72~78.

[https://doi.org/10.1109/IEMCON.2017.8117153]

-

Lee, N., Kim, S., Jeong, I., Sohn, S. and Lee, S., 2020, Ensemble Method using Rule-based and Deep-learning Algorithms for Rotating-machine Diagnostics, Transactions of the Korean Society for Noise and Vibration Engineering, Vol. 30, No. 2, pp. 129~135.

[https://doi.org/10.5050/KSNVE.2020.30.2.129]

-

Kim, S., Oh, K. and Lee, S., 2021, Physics-informed Neural Network for Estimation of Lithium-ion Battery State-of-health, Transactions of the Korean Society for Noise and Vibration Engineering, Vol. 31, No. 2, pp. 177~184.

[https://doi.org/10.5050/KSNVE.2021.31.2.177]

-

Basir, O. and Yuan, X., 2007, Engine Fault Diagnosis based on Multi-sensor Information Fusion using Dempster–Shafer Evidence Theory, Information Fusion, Vol. 8, No. 4, pp. 379~386.

[https://doi.org/10.1016/j.inffus.2005.07.003]

-

Wang, Y. S., Ma, Q. H., Zhu, Q., Liu, X. T. and Zhao, L. H., 2014, An Intelligent Approach for Engine Fault Diagnosis based on Hilbert–Huang Transform and Support Vector Machine, Applied Acoustics, Vol. 75, pp. 1~9.

[https://doi.org/10.1016/j.apacoust.2013.07.001]

-

Tessaro, I., Mariani, V. C. and Coelho, L. D. S., 2020, Machine Learning Models applied to Predictive Maintenance in Automotive Engine Components, Proceedings, Vol. 64, No. 1, p. 26.

[https://doi.org/10.3390/IeCAT2020-08508]

-

Zheng, J. Y., Yang, Z. X., Wu, G. G., Li, X. M. and Wang, J., 2015, FTA-SVM-based Fault Recognition for Vehicle Engine. Proceedings of 2015 IEEE 12th International Conference on Networking, Sensing and Control, pp. 180~184.

[https://doi.org/10.1109/ICNSC.2015.7116031]

-

Zhao, L., Mo, C., Sun, T. and Huang, W., 2020, Aero Engine Gas-path Fault Diagnose based on Multimodal Deep Neural Networks, Wireless Communications and Mobile Computing, Vol. 2020, 8891595.

[https://doi.org/10.1155/2020/8891595]

-

Wolf, P., Mrowca, A., Nguyen, T. T., Bäker, B. and Günnemann, S., 2018, Pre-ignition Detection using Deep Neural Networks: A Step Towards Data-driven Automotive Diagnostics, Proceedings of 2018 21st International Conference on Intelligent Transportation Systems (ITSC), pp. 176~183.

[https://doi.org/10.1109/ITSC.2018.8569908]

-

Wang, Y., Ren, N., Li, J., Liu, B., Si, Q. and Zhang, R., 2021, Research on Fault Detection and Diagnosis Method of Diesel Engine Air System based on Deep Learning, Proceedings of International Conference on Data Mining and Big Data 2021, pp. 328~341.

[https://doi.org/10.1007/978-981-16-7502-7_33]

-

Kuzhagaliyeva, N., Thabet, A., Singh, E., Ghanem, B. and Sarathy, S. M., 2021, Using Deep Neural Networks to Diagnose Engine Pre-ignition. Proceedings of the Combustion Institute, Vol. 38, No. 4, pp. 5915~5922.

[https://doi.org/10.1016/j.proci.2020.10.001]

- Ministry of SMEs and Startups, Korea AI Manufacturing Platform (KAMP), 2020, Ford Engine Vibration AI Dataset, KAIST, Ford, http://kamp-ai.kr (accessed December 14, 2020).

- Bagnall, A., Lines, J., Vickers, W. and Keogh, E., The UEA & UCR Time Series Classification Repository, https://www.timeseriesclassification.com/description.php?Dataset=FordA

Jung Woo Sohn received his Ph.D degree in the Department of Mechanical Engineering from Inha University in 2008. He is now working as a professor in the Department of Mechanical Design Engineering of Kumoh National Institute of Technology. He has interests on the design and control of smart systems using smart materials, smart interaction system based on gesture recognition and haptic system and vibration-based prognostics and health management (PHM).