이벤트 센서를 활용한 운전 중 장비 상태 감시 가능성 고찰

© The Korean Society for Noise and Vibration Engineering

Abstract

Vibration-based condition monitoring technology is regarded as one of the most effective maintenance technologies. Many studies aimed at developing a vision sensor-based condition monitoring system using image processing technologies are being conducted. Event sensors such as dynamic vision sensor have a different operating principle and have many advantages compared to the traditional frame-based sensors; however, for event sensor-based vibration measurement and analysis, the formalized methodology does not exist as an image processing technology. In this study, optical flow and template matching methods were used as tracking methods for event sensor-based condition monitoring. The vibration measurement performance of the representative methods was examined through experiments using a simulator with vertical and horizontal movements. Furthermore, the possibility of extracting changes in the vibration signals according to the state of simulator was investigated.

Keywords:

Condition Monitoring, Event Sensor, Image Processing, Object Tracking키워드:

상태 감시, 이벤트 센서, 영상 처리, 객체 추적1. 서 론

영상 처리 기술의 발달과 함께 비전 센서(vision sensor)를 이용한 기계 장비류의 상태 감시 기술이 활발하게 연구되고 있다(1~5). 비전 센서를 이용한 기계 상태 감시는 계측 영상으로부터 객체 추적(object tracking) 방법을 통해 시계열 신호를 추출하고, 푸리에 변환(Fourier transform)과 같은 다양한 신호 처리를 수행하여 주파수 역 등에서 운전 주파수 등의 유의미한 신호들을 검출하는 방법으로 수행된다(6).

기존에 개발되어 객체 추적에 사용되고 있는 영상 처리 기술들은 대부분 프레임 기반 센서(frame-based vision sensor)에 적용하기 위한 형태로 개발되었다. 하지만 프레임 단위의 영상 처리는 영상 처리 속도가 상대적으로 느리고, 주변 환경에 높은 민감도 및 불필요한 배경 데이터 등의 단점이 존재한다(7).

이벤트 센서(event sensor)는 프레임 단위가 아닌 모든 픽셀이 독립적으로 반응하는 비전 센서이다. 이벤트 센서의 작동 원리는 배경 노이즈(background noise)를 최소화 할 수 있고, 이는 데이터 처리 속도를 빠르게 하는 이점을 지닌다(8). 또한 이벤트 단위의 영상 처리를 통해 마이크로초 단위의 대기 간격으로 객체 추적이 가능하다(8). 하지만 아직까지 이벤트 센서를 이용한 기계 진동 측정 및 분석에 있어서 공식화 되어있는 객체 추적 방법은 거의 없는 상황이다.

이 연구에서는 새로운 유형의 센서인 이벤트 센서를 활용한 장비 상태 감시 가능성을 검토하기 위해 비교적 변위가 큰 강체 거동 장비를 대상으로 이벤트 센서에 적합한 객체 추적 방법을 선정하고, 실험을 통해 진동 신호 도출 성능을 검토하고자 한다. 더 나아가 결함에 따른 진동 신호 변화 도출 가능성을 검토하고, 이벤트 센서 기반 기계 상태 감시 가능성을 제시하고자 한다. 비교적 변위가 큰 강체 거동 장비 대상 이벤트 센서에 적합한 대표적인 객체 추적 방법으로 광류(optical flow) 기반 추적 및 템플릿 매치(template match) 기반 추적이 선정되었고, 성능 검증을 위하여 강체 거동 시뮬레이터를 제작하였다. 선정된 두 객체 추적 방법은 시뮬레이터의 운전 주파수를 도출 할 수 있었고, 광류 기반 객체 추적 방법은 결함으로 인한 진동 신호 변화까지 도출할 수 있음을 검토하였다.

2. 이벤트 센서 기반 객체 추적

2.1 이벤트 센서

망막 세포에서 영감을 받은 이벤트 센서는 모든 픽셀이 독립적으로 밝기 변화에 응답하는 비동기식 센서이다(9). 이벤트 센서는 이벤트(event)의 가변 데이터율(variable data rate) 배열을 출력하며, 이벤트 ek = (xk, yk, tk, pk)는 식 (1)과 같이 정의된 수식을 기반으로 시간 tk에 따라 픽셀 (xk, yk)에서 로그 강도(logarithmic intensity)의 변화가 임계값 ±C를 초과할 때 극성 pk(pk = 1 or 0, 밝기 변화의 증가, 감소)에 의해 발생한다(8,9).

| (1) |

I(xk, yk, tk)는 시간 tk일 때 픽셀 위치 (xk, yk)에서 발생하는 강도(intensity)를 의미한다. 이와 같은 이벤트 발생 원리는 밝기 변화가 없는 정적인 물체를 기록하지 않기 때문에 배경 노이즈를 최소화하고, 데이터 처리 속도를 증가시킨다. 또한 각 픽셀이 마이크로초 단위로 빛의 밝기 변화를 감지하기 때문에 모션 블러(motion blur) 현상 없이 고주파수 모션을 감지할 수 있다.

2.2 영상 처리 기술을 이용한 객체 추적

객체 추적 방법은 계측 영상으로부터 원하는 정보를 얻기 위해 사용되는 영상 처리 기술 중 하나이다. 객체 추적은 객체 탐지, 분류 및 추적 순으로 수행된다. 먼저 객체 탐지는 영상 배열에서 추적 객체를 식별하고 객체의 픽셀을 군집화(cluster)하는 기술로써 프레임 차분법(frame difference), 광류(optical flow), 배경 제거(background subtraction) 등과 같은 방법들을 통해 수행한다(6). 다음으로 추적 객체와 다른 객체를 분류하여야 하는데 이는 식별된 객체를 모양, 모션(motion), 색, 질감(texture) 등을 기반으로 수행된다(6). 마지막으로 영상의 모든 단일 프레임에서 객체의 위치를 찾아 시간에 따른 객체의 경로를 생성하기 위해 객체 추적이 수행된다. 객체 추적은 객체의 특징점을 찾아 모든 프레임에서 이를 대응하여 객체를 추적하는 포인트(Point) 기반 추적, 이전 프레임과 다음 프레임 사이에 객체의 움직임을 계산하여 객체를 추적하는 커널(Kernel) 기반 추적, 이전 프레임에서 생성된 객체의 모델을 이용하여 각 프레임에서의 객체 영역을 추정하는 실루엣(silhouette) 기반 추적으로 분류할 수 있다(6).

2.3 이벤트 센서 기반 객체 추적 방법 선정

이 연구에서는 이벤트 센서의 특성을 고려한 객체 추적 방법으로 객체 추적 기법 중 대표적으로 가장 빈번하게 사용되는 광류(optical flow) 기반 추적과 템플릿 매치(template match) 기반 추적 방법을 선정하고 이에 대한 성능을 검토하였다.

광류 기반 추적은 포인트 추적의 한 종류로써 영상에서 움직임 벡터(motion vector)를 계산하여 광류를 생성하고, 광류 분포 특성에 따라 군집화를 통해 객체를 추적하는 방법이다(10). Lucas-Kanade(11)와 Horn-Schunck(12) 광류 알고리즘은 비교적 간편한 알고리즘으로 많이 알려져 있다. 화소별로 연산이 불가능한 Horn-Schunck 광류 알고리즘과 달리 Lucas-Kanade 광류 알고리즘은 이벤트 센서의 각 픽셀에서 시간에 따라 생성되는 이벤트로부터 광류를 생성하고 군집화하여 추적하기에 적합할 것으로 판단되어 이벤트 센서 기반 객체 추적 방법으로 선정하였다. Lucas-Kanade 알고리즘은 밝기 향상성(brightness constancy)의 가정으로 인해 시간 t와 t + ∆t 사이에서 발생하는 광류 f(x, t)를 다음과 같이 표현할 수 있다(13).

| (2) |

I(x(t), t)는 시간 t일 때 특징점의 위치 x(t)에서의 밝기 강도를 의미한다. 식 (2)를 편미분하고 x축 및 y축의 속도성분을 추가로 적용하면 식 (3)과 같이 표현할 수 있다(13).

| (3) |

Vx와 Vy는 각 축에 대한 속도 성분을 의미한다. 식 (3)은 Lucas-Kanade 알고리즘의 가정 중 하나인 공간 일관성(spatial coherence)의 가정을 기반으로 다음과 같이 전환할 수 있다(13).

| (4) |

식 (4)에 최소자승법을 적용하면 식 (5)의 형태로 도출되며, 이로부터 식 (6)과 같이 각 축에 대한 속도 성분 Vx와 Vy를 도출할 수 있다(13).

| (5) |

| (6) |

템플릿 매치 기반 추적은 커널 추적의 한 종류로써 템플릿 이미지와 입력 이미지 사이의 유사도를 계산하여 객체의 위치를 추정하는 방법이다(14). 템플릿 이미지는 관심 영역에 대한 RoI(region of interest) 설정을 통해 생성된다. 두 이미지 사이의 유사도를 계산하기 위해 사용되는 대표적인 방법은 제곱차(squared differences), 상관관계(correlation), 정규화된 교차 상관(normalized corss correlation), 위상 상관(phase-only correlation) 방법이 있다. 이 중에서도 두 이미지의 위상 상관을 이용한 방법은 상대 변위를 가장 정확하게 계산할 수 있는 방법으로 알려져 있다(15).

템플릿 매치 기반 추적 방법은 이벤트 센서가 배경 노이즈를 최소화하고 관심 있는 동적 객체만을 출력한다는 점에서 시간에 따른 객체의 움직임을 계산하기에 이점을 지니기 때문에 이벤트 센서 기반 객체 추적 방법으로 선정하였다. 템플릿 매치 방법을 사용함에 있어 두 이미지의 유사도를 계산하기 위한 방법으로 위상 상관법을 사용하였다.

두 이미지 사이에서 객체의 상대변위는 두 이미지 사이의 위상 정보에 포함되어 있다(16). 이러한 사실에 기반하여 위상 상관법은 정확성이 요구되는 이미지 매칭에 주로 사용된다(17,18). 두 이미지를 T1(x, y), T2(x, y), 이미지 사이의 상대 변위를 (∆x, ∆y)라 할 때, 두 이미지 사이의 normalized cross power spectrum을 계산하면 식 (7)과 같다.

| (7) |

F1(u, v), F2(u, v)는 T1(x, y), T2(x, y)의 푸리에 변환을 나타내며 *는 켤레복소수를 의미한다. 식 (7)에 푸리에 역변환을 취해 ∆x, ∆y에 대하여 임펄스 함수를 구하면 다음과 같다(19).

| (8) |

식 (8)에서 F-1는 푸리에 역변환을 의미하며, 실수 배열 r(x, y)의 최댓값 좌표 (∆x, ∆y)는 두 이미지 사이의 수평 및 수직 변위의 추정치로 이용될 수 있다. 이를 수식으로 표현하면 식 (9)와 같다.

| (9) |

3. 실험 구성 및 방법

이 연구에서 선정된 객체 추적 방법의 성능을 검토하기 위해 수평, 수직 운동이 가능한 시뮬레이터를 대상으로 다음과 같이 실험을 계획하고 수행하였다.

1. 운전 중 장비 진동 신호 계측 실험: 시뮬레이터의 수평, 수직 운동에 대한 광류 기반 추적 및 템플릿 매치 기반 추적 방법의 진동 신호 계측 가능성을 검토하였다.

2. 기계 결함 계측 실험: 이벤트 센서 기반 상태 감시 가능성을 검토하기 위해 시뮬레이터에 인위적 결함을 조성하였고, 선정된 객체 추적 방법을 활용하여 결함으로 인한 진동 신호 변화를 계측하였다.

(1) 실험 구성

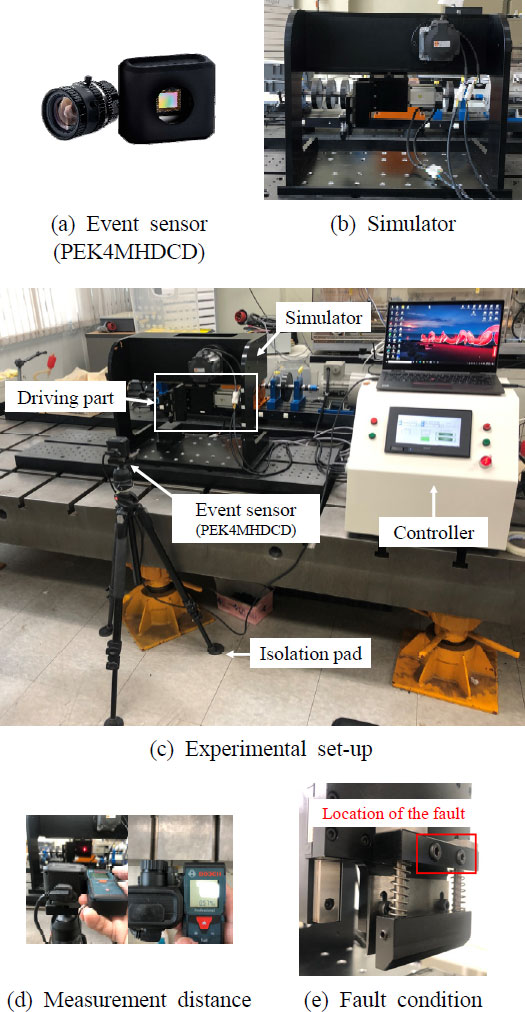

각 실험에서 계측에 사용된 이벤트 센서(모델: PEK4MHDCD)는 Fig. 1(a)와 같고, 시뮬레이터는 Fig. 1(b)와 같이 제작되었다. 시뮬레이터는 제어부와 구동부로 구성되며, 제어부에서 운전 속도(rpm)를 설정하여 작동하도록 설계되었다. 시뮬레이터의 구동부는 공정에서 금속 자재를 절단하기 위해 사용되는 기계를 모방하여 제작되었으며, 수평 방향으로 작동하는 몸통과 수직 방향으로 작동하는 커터 날 부분으로 나뉘어져 있다. Fig. 1(b),(e)를 통해 각 부분의 형상을 확인할 수 있다. 실험은 Fig. 1(c)와 같이 구성하였으며, 실험 중 발생할 수 있는 환경 진동을 제어하기 위해 이벤트 센서를 고정하는 삼각대의 끝단에는 방진 패드(Isolation pad)를 부착하였다. 두 실험에서 이벤트 센서와 시뮬레이터 사이의 계측 거리는 Fig. 1(d)와 같이 레이저 포인터를 이용하여 이벤트 센서의 렌즈부터 구동부까지의 거리를 측정하였다. 또한 기계 결함 계측 실험의 경우 기계에 인위적 결함을 조성하기 위해 Fig. 1(e)와 같이 수직 운동하는 시뮬레이터 구동부의 너트를 느슨하게 하였다.

(2) 실험 방법

실험 방법은 Table 1과 같다. 각 실험에서 계측은 20 sec 동안 진행되었고, 시뮬레이터의 운전 속도는 150 rpm으로 작동하였다. 이벤트 센서에서 계측 대상까지의 거리는 0.576 m였으며, 시뮬레이터의 수평, 수직 운동하는 구동부를 계측하였다. 두 실험에 사용된 광류 기반 추적은 센서 제작사에서 제공한 광류 기반 추적 모듈을 사용하였고, 템플릿 매치 기반 추적은 Visual studio 2019를 사용하여 구현하였다. 제작사에서 제공되는 광류 기반 추적 모듈은 계측 영상에서 발생하는 이벤트를 군집화하여 객체를 식별하고, 개별 ID 박스를 부여하여 이를 추적하는 원리로 작동한다.

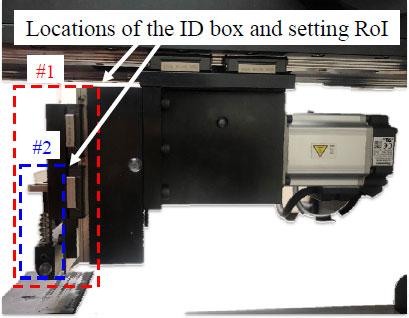

각 실험에서 사용된 ID 박스 및 템플릿 이미지 생성을 위한 RoI 위치는 Fig. 2와 같다. Fig. 2의 #1은 수평 운동, #2는 수직 운동에 대한 설정을 의미한다. 각 실험에서 진동 신호는 객체 추적 결과로부터 시간에 따른 픽셀 변위량을 추출하였고, 푸리에 변환을 취하여 진동 신호를 도출하였다.

4. 실험 결과 및 고찰

4.1 운전 중 장비 진동 신호 계측 결과

이벤트 센서를 활용한 시뮬레이터 계측 영상으로부터 광류 및 템플릿 매치 기반 객체 추적 가능성 및 운전 주파수 도출 여부를 검토한 결과 다음과 같다.

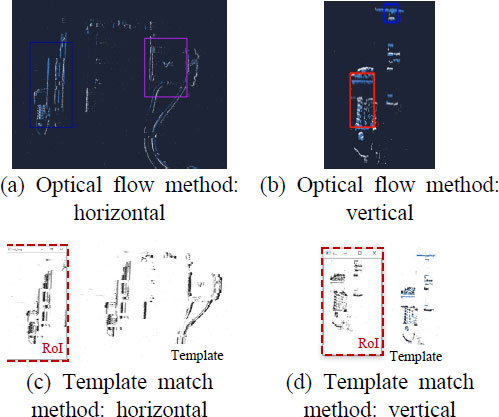

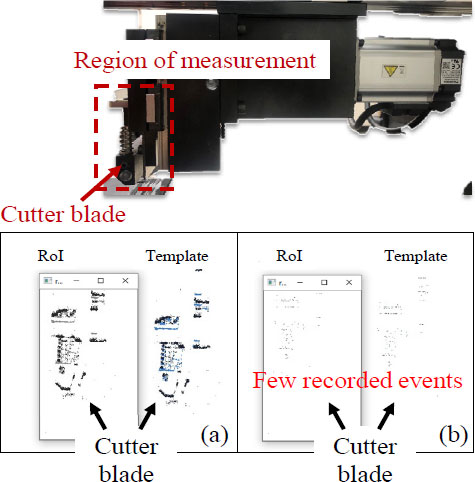

시뮬레이터의 구동부를 추적하기 위해 생성된 ID 박스와 템플릿 이미지는 Fig. 3과 같다. Fig. 3(a), (b)는 광류 기반 모듈을 사용하여 수평, 수직 운동을 추적하는 과정이며 Fig. 3(c), (d)는 템플릿 매치 기반 추적 과정이다. 두 추적 방법 모두 Fig. 2와 같이 시뮬레이터 구동부의 몸통과 커터 날 부분에 ID 박스 및 RoI 설정이 수행되었다.

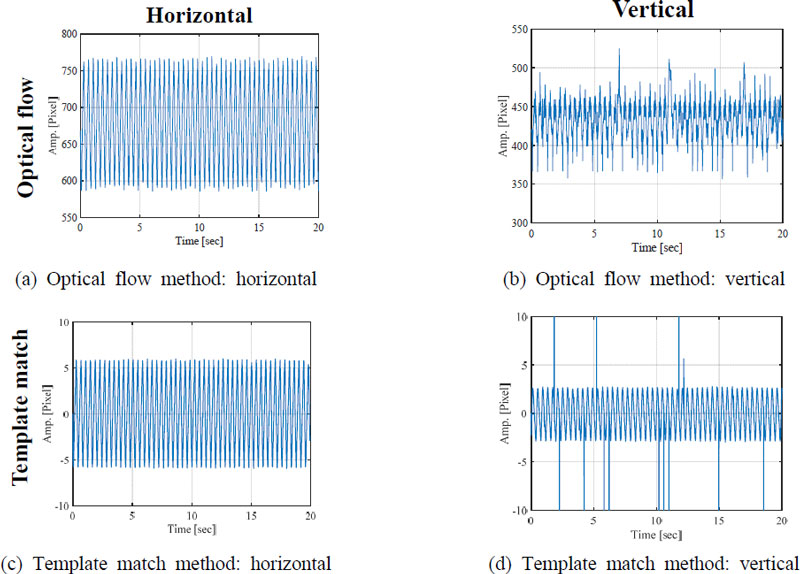

위와 같은 객체 추적 과정을 통해 도출된 시간에 따른 픽셀 변위량은 Fig. 4와 같다. Fig. 4(a), (b)와 Fig. 4(c), (d)는 시뮬레이터의 수평, 수직 운동에 대한 광류 기반 추적 및 템플릿 매치 기반 추적에 대한 결과이다. Fig. 4(a), (c), (d)에서 도출된 수평, 수직 운동의 픽셀 변위량은 합리적으로 도출되었으나 Fig. 4(b)의 결과는 비교적 불규칙적으로 도출되었다. 이러한 현상은 커터 날의 수직 운동을 추적하는데 있어서 광류 추적 모듈에서 생성되는 ID 박스의 크기가 일시적으로 변하면서 도출된 결과로 판단된다.

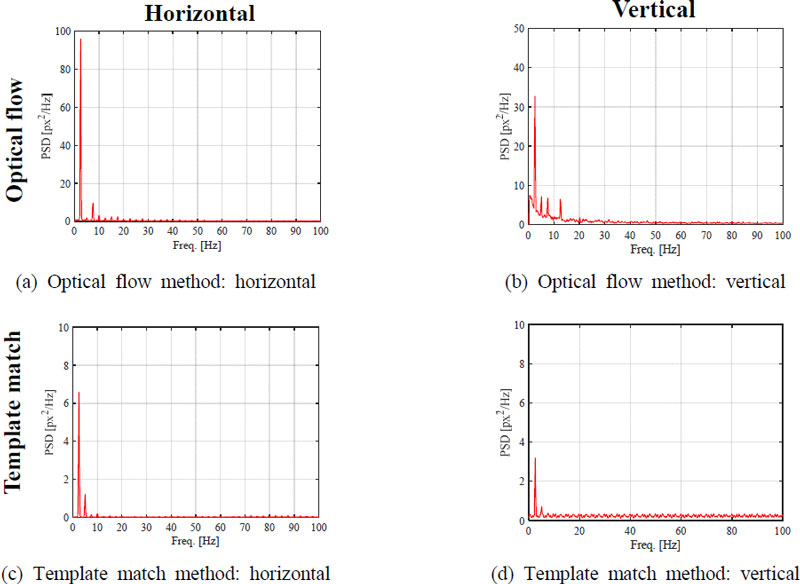

다음으로 시뮬레이터의 운전 주파수 도출 여부를 검토하기 위해 Fig. 4의 각 진동 신호에 푸리에 변환을 취한 결과 Fig. 5와 같이 도출되었다. Fig. 5(a), (b)는 광류 기반 방법, Fig. 5(c), (d)는 템플릿 매치 기반 방법에 대한 푸리에 변환 결과로써 모든 진동 신호에서 시뮬레이터의 운전 주파수인 2.5 Hz와 고조파 성분들이 도출되었다.

이 실험을 통해 이벤트 센서 계측 영상에서 광류 및 템플릿 매치 기반 객체 추적이 가능하며, 시뮬레이터의 수평, 수직 운동에 대한 운전 주파수 검출이 가능함을 검토하였다. 또한, 위와 같은 결과들을 통해 이벤트 센서를 활용한 장비 상태 감시가 가능할 것으로 판단된다.

4.2 기계 결함 계측 결과

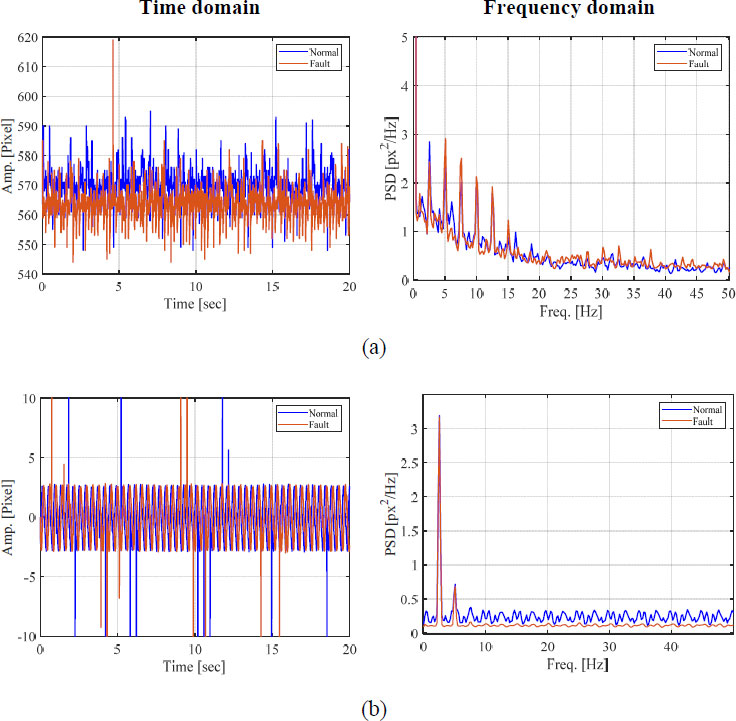

이 실험에서는 4.1절에서 검토된 객체 추적 방법을 활용한 시뮬레이터의 결함 유무에 따른 진동 신호 변화 검출 가능성을 검토하였다. 시뮬레이터의 정상상태와 결함상태에서의 진동 신호를 도출한 결과 Fig. 6, Table 2와 같다.

Comparison of vibration signals between normal and fault conditions: Results of (a) optical flow method and (b) template match method

Power spectral density of fundamental signals and their harmonic frequencies in normal and fault conditions

시뮬레이터 구동부에 인위적으로 조성된 결함은 커터 날과 몸통 사이에 정렬 불량(misalignment)을 유발한다. 일반적으로 정렬 불량은 기계의 제2 고조파 성분의 진폭이 운전 주파수보다 크게 도출된다(20). Fig. 6(a)는 광류 기반 추적 결과이며, 도출된 진동 신호의 시간역에서 정상 및 결함상태의 RMS(root-mean-squared)를 계산하였을 때 각각 5.32, 5.13으로 정상상태와 결함상태 사이의 차이가 약 1.03배로 큰 변화는 도출되지 않았다. 반면에 주파수역에서 정상상태일 때 도출된 진동 신호는 시뮬레이터의 운전 주파수인 2.5 Hz가 주성분으로 도출되었으나, 결함상태에서는 고조파 성분인 5 Hz의 진폭이 2.5 Hz보다 약 1.2배 높게 도출된 것을 Table 2를 통해 확인할 수 있다.

Fig. 6(b)는 템플릿 매치 기반 추적 결과이며, 광류 기반 추적 결과와 다르게 주파수역 진동 신호에서 정상 및 결함상태 모두 운전 주파수인 2.5 Hz의 진폭이 가장 높게 도출되었다. 이러한 결과는 Fig. 6(b) 시간역 진동 신호에서 발산하는 신호로 인해 발생된 것으로 판단된다. 이벤트는 시간에 따른 빛의 변화가 발생될 때 기록되는데, 시뮬레이터가 마이크로 초 단위로 계측되면서 구동부의 운동 방향이 역전하는 변곡 위치에서 이벤트가 일시적으로 기록되지 않은 순간들이 Fig. 7과 같이 발생하였다. Fig. 7(a)는 이벤트가 일반적으로 기록될 때의 프레임이며, Fig. 7(b)는 이벤트가 거의 기록되지 않는 순간의 프레임이다. 이로 인해 정확한 진동 신호를 도출하지 못한 것으로 판단된다.

이와 같은 결과를 통해 이벤트 센서 기반 수평, 수직 방향 변위가 큰 강체 거동으로 운동하는 장비 상태 감시에는 광류 기반 추적 방법이 템플릿 매치 기반 추적 방법보다 효과적임을 검토하였다.

5. 결 론

이 연구는 장비 상태 감시를 위해 이벤트 센서 기반 객체 추적 방법으로 광류 기반 추적 및 템플릿 매치 기반 추적 방법을 검토하였고, 진동 계측 성능 검토를 위해 제작된 시뮬레이터를 활용하여 계측 및 신호 처리를 수행한 결과를 정리·분석하였다. 이 연구에서 수행한 내용을 요약하면 다음과 같다.

(1) 시뮬레이터를 활용한 진동 신호 도출 실험으로부터 광류 및 템플릿 매치 기반 객체 추적이 가능하고, 장비의 운전 주파수 도출이 가능함을 확인하였다.

(2) 광류 기반 추적 방법은 기계 결함으로 인한 진동 신호 변화 도출이 가능하였으며, 주파수역 진동 신호의 주성분은 결함상태일 때 5 Hz로 도출되었고, 진폭은 운전 주파수인 2.5 Hz에 비해 약 1.2배 높게 도출되었다. 그러나 템플릿 매치를 활용하는 영상 처리 방법으로는 결함으로 인한 강체 거동 및 진동 신호 변화를 도출하지 못하였다.

(3) 이벤트 센서를 활용한 수평, 수직 방향으로 변위가 큰 강체 거동을 포함하는 장비의 상태 감시에는 템플릿 매치 방법보다 광류 기반 방법이 효과적임을 확인하였다.

이 연구에서 사용된 시뮬레이터의 운동은 수평, 수직 방향 강체 거동에 한정되었으며, 이벤트 센서를 활용한 장비 상태 감시 기술 개발을 위해 비교적 변위가 작은 회전체와 같은 장비에 대한 진동 신호 도출 가능성 또한 검토가 필요할 것으로 판단된다. 하지만, 이 연구는 새로운 유형의 이벤트 센서를 이용한 기계 진동 신호 및 결함으로 인한 진동 변화 도출 가능성을 검토하였고, 이벤트 센서 기반 기계 상태 감시 기술의 확장을 위한 발판이 될 것으로 판단된다.

Acknowledgments

이 연구는 부산대학교 기본연구지원사업(2년)의 지원으로 수행되었습니다.

References

-

Wahbeh, A. M., Caffrey, J. P. and Masri, S. F., 2003, A Vision-based Approach for The Direct Measurement of Displacements in Vibrating Systems, Smart Materials and Structures, Vol. 12, No. 5, p. 785.

[https://doi.org/10.1088/0964-1726/12/5/016]

-

Wang, W. J. and McFadden, P. D., 1993, Early Detection of Gear Failure by Vibration Analysis: ii. Interpretation of the Time-frequency Distribution using Image Processing Techniques, Mechanical Systems and Signal Processing, Vol. 7, No. 3, pp. 205~215.

[https://doi.org/10.1006/mssp.1993.1009]

-

Lee, J. J. and Shinozuka, M., 2006, Real-time Displacement Measurement of a Flexible Bridge Using Digital Image Processing Techniques, Experimental Mechanics, Vol. 46, No. 1, pp. 105~114.

[https://doi.org/10.1007/s11340-006-6124-2]

-

Kim, K. Y. and Kwak, M. K., 2005, Measurement of Large-amplitude and Low-frequency Vibrations of Structures Using the Image Processing Method, Transactions of the Korean Society for Noise and Vibration Engineering, Vol. 15, No. 3, pp. 329~333.

[https://doi.org/10.5050/KSNVN.2005.15.3.329]

-

Kong, Y., Yinan, M., Jeon, J. Y. and Park, G., 2021, Motion Phase-based 2-Dimensional Displacement Measurements under Various Illumination Condditions with Maker and Filter Design, Transactions of the Korean Society for Noise and Vibration Engineering, Vol. 31, No. 4, pp. 408~418.

[https://doi.org/10.5050/KSNVE.2021.31.4.408]

-

Balaji, S. R. and Karthikeyan, S., 2017, A Survey on Moving Object Tracking Using Image Processing, 11th IEEE International Conference on Intelligent Systems and Control, pp. 469~474.

[https://doi.org/10.1109/ISCO.2017.7856037]

-

Zhang, D., Guo, J., Lei, X. and Zhu, C., 2016, A High-speed Vision-based Sensor for Dynamic Vibration Analysis Using Fast Motion Extraction Algorithms, Sensors, Vol. 16, No. 4, p. 572.

[https://doi.org/10.3390/s16040572]

-

Lai, Z., Alzugaray, I., Chli, M. and Chatzi, E., 2020, Full-field Structural Monitoring using Event Cameras and Physics-informed Sparse Identification, Mechanical Systems and Signal Processing, Vol. 145, p. 106905.

[https://doi.org/10.1016/j.ymssp.2020.106905]

-

Gallego, G., Delbrück, T., Orchard, G., Bartolozzi, C., Taba, B., Censi, A., Leutenegger, S., Davison, A. J., Conradt, J., Daniilidis, K. and Scaramuzza, D., 2022, Event-based Vision: A Survey, IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 44, No. 1, pp. 154~180.

[https://doi.org/10.1109/TPAMI.2020.3008413]

- Shantaiva, S., Verma, K. and Mehta, K., 2015, Multiple Object Tracking using Kalman Filter And Optical Flow, European Journal of Advances in Engineering and Technology, Vol. 2, No. 2, pp. 34~39.

- Lucas, B. D. and Kanade, T., 1981, An Iterative Image Registration Technique with an Application to Stereo Vision, IJCAI’81: 7th International Joint Conference on Artificial Intelligence, Vol. 2, pp. 674~679.

-

Horn, B. K. and Schunck, B. G., 1981, Determining Optical Flow, Artificial Intelligence, Vol. 17, No. 1~3, pp. 185~203.

[https://doi.org/10.1016/0004-3702(81)90024-2]

- Kim, S. M., Lee, J. H., Roh, S. G. and Park, S. Y., 2010, The Study of Pre-processing Algorithm for Improving Efficiency of Optical Flow Method on Ultrasound Image, Journal of the Institute of Electronics Engineers of Korea, Vol. 47, No. 5, pp. 24~32.

-

Dobbs, S. E., Schmitt, N. M. and Ozemek, H. S., 1984, QRS Detection by Template Matching using Real-time Correlation on a Microcomputer, Journal of Clinical Engineering, Vol. 9, No. 3, pp. 197~212.

[https://doi.org/10.1097/00004669-198407000-00002]

-

Foroosh, H., Zerubia, J. B. and Berthod, M., 2022, Extension of Phase Correlation to Subpixel Registration, IEEE Transactions on Image Processing, Vol. 11, No. 3, pp. 188~200.

[https://doi.org/10.1109/83.988953]

-

Tian, Q. and Huhns, M. N., 1986, Algorithms for Subpixel Registration, Computer Vision, Graphics, and Image Processing, Vol. 35, No. 2, pp. 220~233.

[https://doi.org/10.1016/0734-189X(86)90028-9]

- Kuglin, C. D., 1975, The Phase Correlation Image Alignment Method, Proceedings of the International Conference Cybernetics Society, pp. 163~165.

- Miura, M., Sakai, S., Aoyama, S., Ishii, J., Ito, K. and Aoki, T., 2012, High-accuracy Image Matching using Phase-only Correlation and Its Application, Proceedings of the 2012 IEEE/SICE Annual Conference, pp. 307~312.

- Cozzella, L. and Spagnolo, G. S., 2014, Phase-only Correlation Function by Means of Hartley Transform, JSM Mathematics and Statistics, Vol. 1, No. 1, pp. 1~8.

-

Perez, R. X., 2022, Maintenance, Reliability and Troubleshooting in Rotating Machinery, Scrivener Publishing, Becerly, MA.

[https://doi.org/10.1002/9781119631668]

Woongjae Na received the M.S. in the Dept. of safety engineering from Chungbuk National University. He is currently a Researcher in the Global Core Research Center for Ships and Offshore Plants (GCRC), Pusan National University. His research interests are in the area of image signal processing, rotor system analysis, and safety engineering.

Kyung Ho Sun is principle researcher in the Department of System Dynamics, Korea Institute of Machinery & Materials. Dr. Sun’s research interests include prognostics and health management for rotating machinery.

Byung Ock Kim is principle researcher in the Department of System Dynamics, Korea Institute of Machinery & Materials. Dr. Kim’s research interests include rotordynamic and lubrication analysis anc design for rotating machinery.

Yun-ho Shin is Assistant Professor in the Department of Naval Architecture and Ocean Engineering, Pusan National University. Prof. Shin’s research interests include vibration isolation system design, rotor system analysis and vibration visualization.